Искусственный интеллект (ИИ) испытывает стремительное развитие, бросая вызов возможностям платформ по выявлению манипулированных видео. В законодательной области, в Мексике, Закон Олимпии является революционной нормой в вопросах цифрового сексуального насилия, квалифицируя манипуляцию изображениями с помощью ИИ как преступление цифрового насилия. Этот закон предусматривает финансовые санкции и наказания до шести лет тюремного заключения. Тем не менее, нормативы по использованию ИИ до сих пор не полностью определены ни в Мексике, ни в других странах.

Использование ИИ для создания дипфейков, то есть ложных видео и аудио, приводит к увеличению случаев мошенничества и дезинформации на глобальном уровне. Общедоступные лица, такие как политики, артисты и бизнесмены, являются главными жертвами этой технологии, которая позволяет подменять их образ или голос с недобрыми намерениями. По информации специализированной платформы по вопросам идентичности и соблюдения норм Sumsub, в Мексике наблюдается значительный рост инцидентов, связанных с дипфейками, с увеличением на 500% между 2022 и 2023 годами.

На сегодняшний день доступ к генеративному ИИ для создания или изменения внешности человека становится все более обычным. Уго Монрой, директор по развитию бизнеса в Xira, упоминает, что существуют приложения и программное обеспечение, которые интегрируют эти инструменты. Наиболее подделываемыми знаменитостями обычно являются те, кто имеет мировой резонанс, чьи изображения и видео легко доступны и используются для создания вводящего в заблуждение, юмористического или проблемного контента.

Согласно Глобальному обзору онлайн-безопасности 2024 года от Microsoft, 71% пользователей социальных сетей рассматривают мошенничество как свою главную озабоченность в связи с проблемами, связанными с ИИ. На втором месте 69% указывают на дипфейки и сексуальное насилие в сети как на значительные проблемы. Недавно был подписан международный договор для регулирования этой технологии, в котором участвовала Мексика. Эксперты Xira упоминают о существовании международных законов, которые продвигают внедрение предупреждений в цифровой контент для идентификации того, были ли видео или фотографии сгенерированы с помощью ИИ.

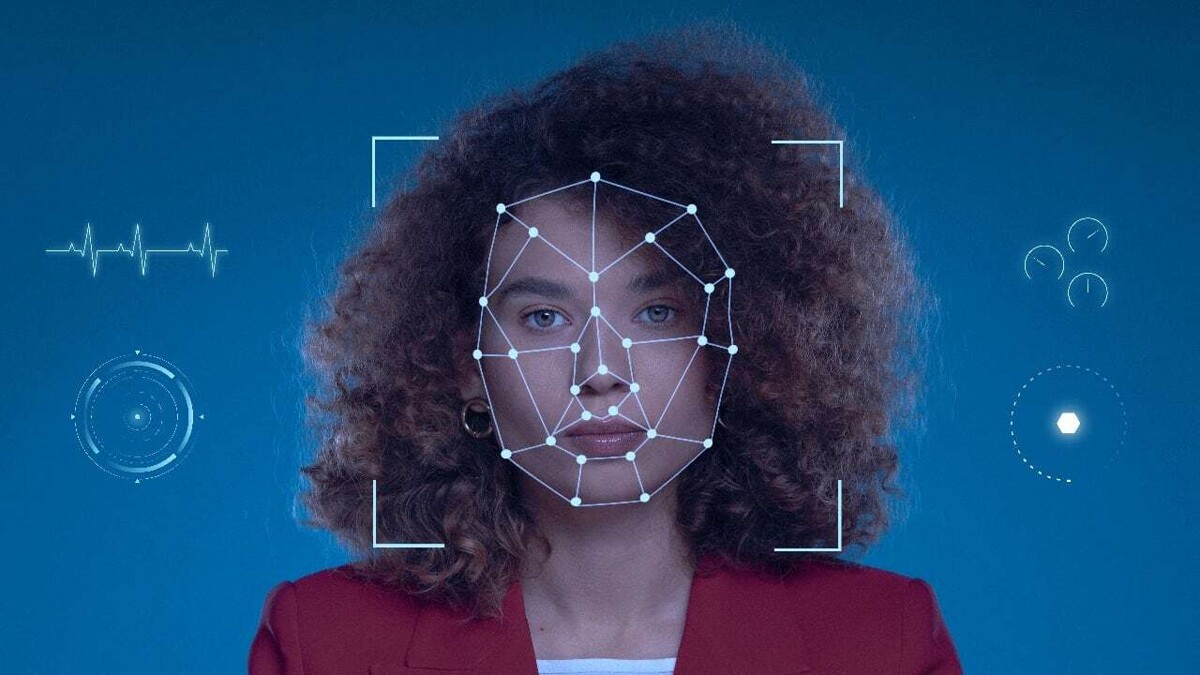

Для выявления дипфейка специалисты рекомендуют обращать внимание на признаки подделки, такие как нерегулярные движения в области рта, рук, лица, глаз и других частей тела. Также было предупреждено о использовании дипфейков в возможных финансовых мошенничествах, вымогательствах и распространении фейковых новостей. Некоторые знаменитости стали жертвами этих технологий, даже в более частных контекстах, таких как создание откровенного контента без их согласия. Цифровые платформы начали внедрять инструменты для обнаружения, чтобы бороться с этой проблемой.